El problema no es la IA: es el mal uso, el mal periodismo y la mala salud de un tribunal

La noticia de El Español del 9 de abril de 2026 acierta en señalar que puede haber un problema serio, pero falla al contarlo. Decir que se abre expediente a un juez “por hacer una sentencia con IA” no es fiel a la realidad jurídica. El CGPJ no ha prohibido la IA en bloque: su Instrucción 2/2026 de 28 de enero, permite usar sistemas de IA facilitados por la Administración o por el propio Consejo como apoyo, exige revisión personal, completa y crítica del borrador, y prohíbe delegar la decisión judicial o incorporar datos judiciales a sistemas no autorizados. El foco, por tanto, no está en la herramienta, sino en el modo en que se utiliza y en si el juez conserva en todo momento el control efectivo de la resolución.

El titular confunde más de lo que aclara

Equiparar este caso a “hacer una sentencia con IA” es tan impreciso como decir que el problema de una mala resolución antes era “usar un procesador de textos” o “copiar de una base de datos”. La tecnología, por sí sola, no invalida nada. Lo que sería reprochable, si los hechos son como se cuentan, es otra cosa: usar una plataforma generalista no autorizada, introducir en ella el procedimiento, encargarle la redacción de la resolución y luego firmar un texto sin una revisión seria. Eso no desacredita la IA; desacredita, en su caso, la forma de trabajar del juez.

El verdadero problema jurídico no es tecnológico, sino profesional

La cuestión de fondo no es tecnológica, sino estrictamente jurídica y profesional. Los arts. 24.1 y 120.3 de la Constitución exigen tutela judicial efectiva y sentencias motivadas, lo que implica que quien firma una resolución debe haber controlado realmente su contenido, su razonamiento y su fundamentación. Por eso, si un juez utiliza una herramienta para ordenar ideas, revisar estilo o sistematizar materiales, el problema no está ahí. El problema empieza cuando la asistencia se convierte en sustitución, cuando la motivación deja de ser verdaderamente propia o cuando el texto final revela que no ha existido una revisión personal y crítica suficiente. En ese punto ya no hablamos de innovación, sino de déficit de función jurisdiccional. En ese punto ya no hablamos de modernidad ni de innovación, sino de rigor judicial. Y ese mismo reproche habría existido antes con cualquier “copia y pega” mal hecho, aunque no hubiera intervenido ninguna IA.

Además, la propia noticia introduce un matiz que debilita su tono grandilocuente: afirma que la decisión ya había sido deliberada con el resto del tribunal y que el problema se produjo en la ponencia redactada por el magistrado. Si eso fue así, hablar de que una IA “sustituyó” por completo la función jurisdiccional exige mucha más precisión de la que ofrece el artículo. El debate real pasaría a ser si hubo delegación indebida de la motivación escrita, si se comprometió la confidencialidad del expediente y si el ponente incumplió su deber de revisión personal. Es grave, sí; pero no es exactamente lo mismo que presentar a una máquina “juzgando”.

Si se subió el expediente, hay una cuestión añadida de confidencialidad

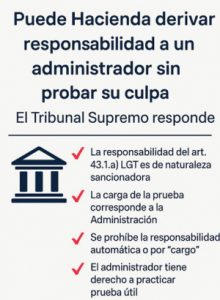

Aquí sí aparece un aspecto especialmente sensible. La Instrucción 2/2026 prohíbe utilizar en la actividad jurisdiccional sistemas de IA no facilitados por la Administración competente o por el propio CGPJ, y además veta la incorporación de datos judiciales a esos sistemas. Pero, junto a ello, entra también en juego el deber de reserva propio de jueces y magistrados, recogido en el art. 396 de la Ley Orgánica del Poder Judicial. Por eso, si realmente se introdujeron en una plataforma generalista datos del procedimiento, el reproche no sería sólo metodológico o de calidad técnica de la resolución, sino también de confidencialidad y eventual relevancia disciplinaria. Ese es, probablemente, uno de los puntos jurídicamente más serios del caso.

Lo más extraño no es sólo el juez: también lo es el tribunal

La noticia dice que fueron los propios compañeros de Sala quienes comunicaron los hechos al presidente de la Audiencia. Eso, en un órgano colegiado, resulta muy llamativo. No sabemos si hubo enemistad previa, mala relación personal o simple cumplimiento del deber institucional, y sería irresponsable afirmarlo sin más datos. Pero sí puede decirse algo: cuando un tribunal llega al punto de que sus propios miembros denuncian a uno de los suyos en vez de reconducir primero el problema dentro del órgano, la situación revela una quiebra interna que va más allá del error de un solo ponente.

Por eso, el CGPJ quizá debería mirar algo más que la conducta individual del magistrado expedientado. Si los hechos han ocurrido como se narran, aquí puede haber también un problema de funcionamiento colegiado, de confianza interna y de salud institucional del tribunal. Y eso afecta a la Justicia en un sentido más amplio. Abrir expediente a un juez puede ser necesario; conformarse sólo con eso puede ser insuficiente.

Una noticia poco completa sobre un asunto demasiado serio

También hay que decirlo con claridad: la información periodística se queda corta. No identifica al magistrado, no ofrece la resolución afectada, no permite contrastar el texto de la sentencia ni el alcance exacto de las consultas a la IA, y aun así construye un relato casi cerrado. En un asunto tan sensible, que afecta a la credibilidad de la función pública jurisdiccional, el periodismo debería aportar más contexto y menos eslogan. Criticar una actuación judicial concreta exige precisión, no un titular diseñado para escandalizar.

Conclusión

La noticia denuncia un hecho potencialmente grave, pero lo enfoca mal. El problema no es “hacer una sentencia con IA”, sino usar mal una herramienta, comprometer la confidencialidad del procedimiento y firmar, en su caso, una resolución sin el control personal exigible. Y, junto a ello, aparece otra anomalía que no debería ignorarse: la extraña descomposición interna de un tribunal cuyos propios miembros terminan denunciándose entre sí.

La Justicia no se protege demonizando la tecnología, sino exigiendo jueces rigurosos, tribunales sanos, y, cómo no, un periodismo que informe con verdad y contexto.

En nuestro despacho analizamos el impacto jurídico real de la IA en la práctica forense y judicial, usamos IAs generalistas para ciertas tareas, y otras específicas de nuestro sector jurídico para otras. La tecnología está al servicio de la sociedad, y también de nuestra profesión, y no debemos ni podemos ignorarla. Tan imprudente sería no utilizar la IA, como usarla indebidamente, por lo que evitemos escandalizarnos con titulares periodísticos sensacionalistas, y procuremos mantener la inquietud por trabajar cada día mejor para contribuir a una sociedad más justa, más libre y, en definitiva, con ética y moral.